Edge Computing

Esteban David Alvarez Bor

davix93a@gmail.com

Estudiante de Ingeniería en Ciencias y Sistemas - USAC

Palabras Clave: Cloud Computing, Edge Computing, AWS, Cloud, IoT, Latencia.Edge Computing es un concepto relativamente nuevo, surge a partir del concepto de Cloud Computing, en el cual se intenta acercar el almacenamiento y procesamiento a la fuente de los datos, para no enviar toda la data a un servidor remoto en la nube o a un sistema centralizado que procese la misma. Esto representa un cambio en la arquitectura provista por los sistemas tradicionales de Internet de las cosas, que utilizan Cloud Computing con la finalidad de proveer a sistemas la capacidad de procesamiento de datos, casi en tiempo real, mejorando así el nivel de respuesta de aquellos sistemas que su información es de suma importancia, como dispositivos médicos, industriales y muy recientemente en vehículos autónomos.

IEEE define Internet de las cosas como “Un campo de aplicación que integra campos tecnológicos y sociales” . La firma de análisis Gartner nos proporciona una definición más extensa de la que podemos extraer "IoT es una red dedicada de objetos físicos con tecnología integrada que mide y comunica la interacción entre factores internos y externos" , además dentro de esta definición nos menciona un factor muy importante, como la data capturada permite a las compañías aprender el comportamiento y uso de sus sistemas, permitiéndoles tomar una serie de acciones preventivas o mejorar sus procesos de negocios.

Si consideramos un sistema de Internet de las Cosas, desarrollado actualmente bajo el concepto de Cloud Computing, el cual Amazon Web Services define como “La entrega a pedido de poder de cómputo, almacenamiento, aplicaciones y recursos de TI a través de una plataforma en la nube en internet con precios basados en el consumo.”, hay dos factores clave que debemos considerar al momento de evaluar el grado de importancia como lo son la velocidad de procesamiento y el tiempo de respuesta. Aunque hay sistemas que se acoplan perfectamente a un entorno en la nube como en el caso de sistemas de domótica, hay otros como en el caso de sistemas de Internet de las Cosas del sector médico, bancario e industrial, que requieren de un grado superior de procesamiento y respuesta debido a la sensibilidad de la información que maneja, y factores como la conexión a internet, el lugar en donde se despliega el servidor, puede influir en los factores mencionados anteriormente.

Para estos sistemas especiales, en los cuales la velocidad de procesamiento y respuesta son esenciales e indispensables, surge el concepto de Edge Computing o Cómputo en el borde, en el cual, su premisa es acercar tanto como sea posible el almacenamiento y procesamiento de la data al dispositivo que la genera, con el propósito de eliminar la latencia en estos procesos. Este concepto toma fuerza cuando analizamos la cantidad masiva de datos generada por un dispositivo de Internet de las Cosas, y el tiempo considerable que a esta le toma al ser enviada y analizada a través de la red, cuando decisiones como detener una línea de ensamblaje, reactivar una planta eléctrica o incluso diagnosticar mediante un monitor biométrico en el cual milisegundos pueden ser valiosos.

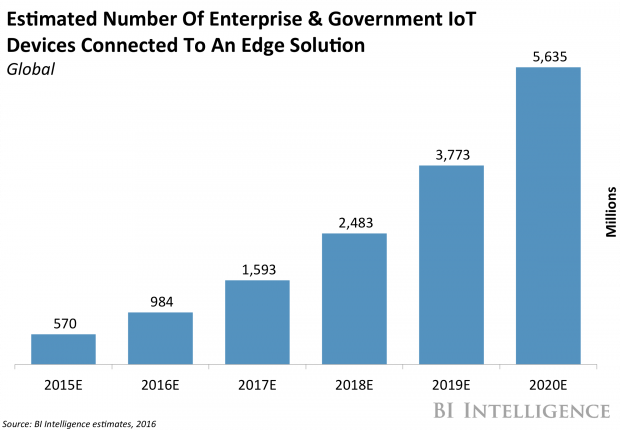

Imagen 1 - Fuente: BI Intelligence

Un estudio realizado por BI Intelligence pronosticó un estimado de 5.635 mil millones de dispositivos conectados bajo el modelo de Edge Computing para el año 2020 tanto en sectores del gobierno como de la industria.

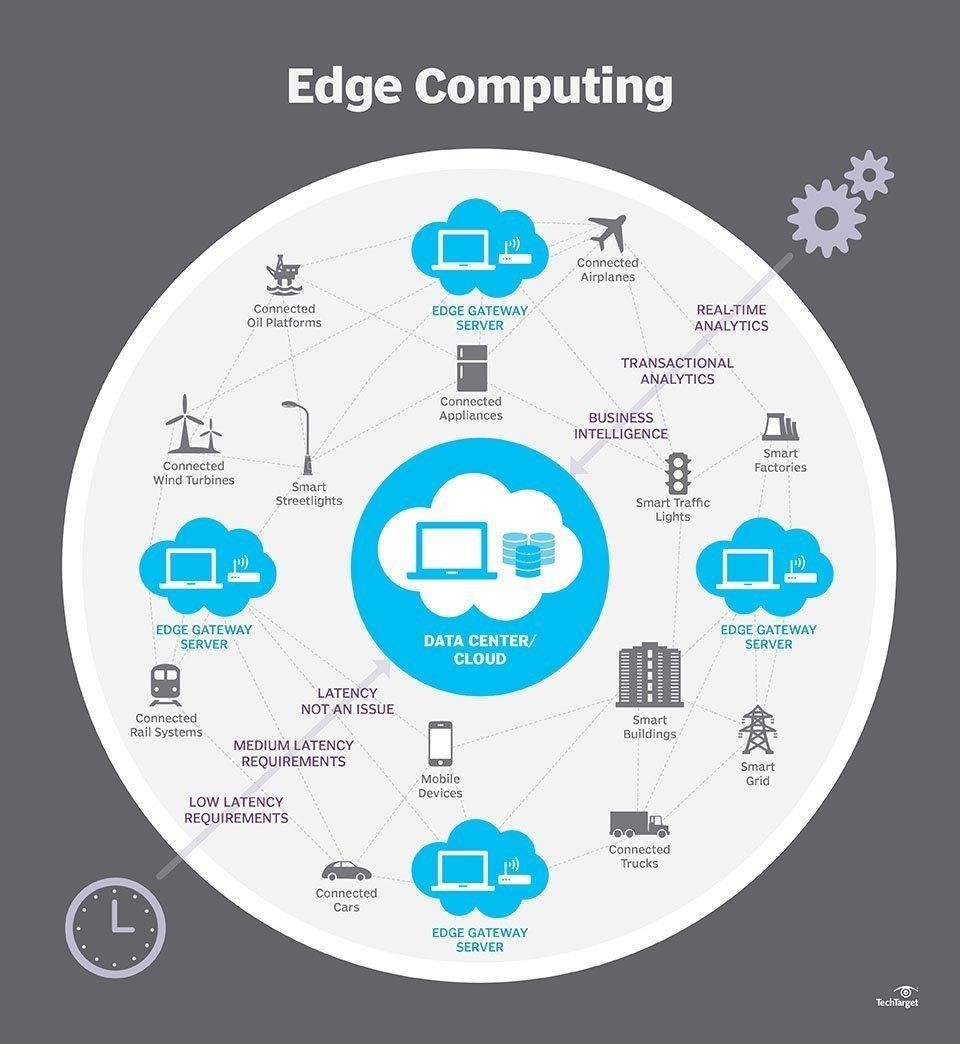

Para poder entender mejor el concepto de Edge Computing, se creó el concepto de Fog Computing o Cómputo en la niebla, donde podemos hacer la analogía con una nube física, en la cual la niebla es la parte exterior o borde de ella. Mas formalmente se define como “Una infraestructura de computo descentralizada en la cual tanto la data, cómputo, almacenamiento y aplicaciones están localizadas en un lugar intermedio de la fuente de datos y la nube.”. Este concepto define el estándar de como Edge Computing debe trabajar para facilitar las operaciones del modelo.

Imagen 2 - Fuente: TechTarget

En la actualidad, el ejemplo más acertado del uso de Edge Computing es en los sistemas utilizados por los vehículos autónomos. Estos vehículos, cuentan con un amplio conjunto de sensores los cuales recolectan grandes cantidades de información como velocidad, distancia, ruta, detección de objetos entre otros.

Un artículo escrito por Kathy Winter, para Intel Newsroom, indica que se estima una cantidad de cuatro terabytes de datos recolectados por un vehículo autónomo en un solo día. Estos datos recolectados requieren de un rápido procesamiento y respuesta debido a que se espera una conducción lo más óptima y segura posible. Aquí entra Edge Computing agilizando el procesamiento de los datos generando resultados en tiempo real para un sistema complejo.

Imagen 3 - Fuente: Intel

Plataformas de Cloud Computing han desarrollado servicios capaces de dar solución a la problemática de latencia en despliegues totalmente en la nube, Amazon Web Services proporciona un servicio llamado Lambda@Edge, el cual tiene la finalidad de acercar la ejecución de código al usuario, mejorando el rendimiento y reduciendo la latencia, sin la necesidad de administrar infraestructura en distintas partes del mundo. IoT Greengrass es otro servicio proporcionado por AWS permitiendo una interacción a nivel local en función de los datos generados y el uso de la nube para tareas administrativas, análisis y almacenamiento duradero.

Conclusiones:

Edge Computing busca reducir la latencia acercando el procesamiento de los datos lo más cerca del lugar de donde se originan.

Fog Computing define el estándar de como Edge Computing debería trabajar.

El uso de Edge Computing depende de las características de nuestro sistema, la velocidad de procesamiento y velocidad de respuesta requerida para satisfacer las necesidades de este.

Sistemas de información vital o de suma importancia son los principales en acoplarse al modelo de Edge Computing.

Referencias bibliográficas:

IEEE. (2015). towards a definition of the Internet of Things (IoT). 28/03/19, de IEEE

Amazon Web Services. (2019). What it Cloud Computing? 28/03/19, de AWS

Margaret Rouse. (2019). Fog computing. 28/03/19, de IoT Agenda, TechTarget fogging)

Amazon Web Services. (2019). AWS IoT Greengrass. 28/03/19, de AWS